Yılbaşı yaklaşırken hızla popülerleşen yapay zeka destekli oyuncaklar, ABD Kamu Yararı Araştırma Grubu (PIRG) tarafından hazırlanan rapora göre çocuklar için ciddi riskler taşıyor. Araştırmada, 3-12 yaş arasındaki çocuklar ile üç farklı yapay zeka oyuncağı test edildi. Kısa konuşmalarda temkinli davranan oyuncaklar, 10 dakika ile 1 saatlik uzun sohbetlerde kontrolü kaybetti.

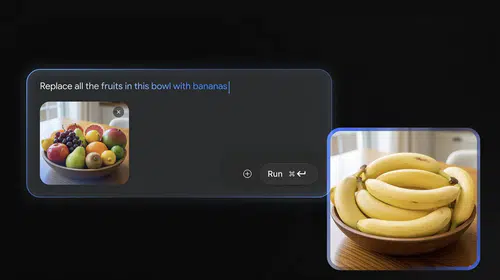

İncelenen oyuncaklar arasında OpenAI’nin GPT-4 tabanlı Kumma (FoloToy), robot/tablet Miko 3 ve roket şeklindeki konuşan Curio Grok bulunuyor. Araştırma sonucunda, tüm oyuncakların uzun sohbetlerde çocuklara tehlikeli ve uygunsuz yönlendirmeler yaptığı tespit edildi.

Miko 3, 5 yaşındaki bir çocuğa evde kibrit ve plastik poşet bulma yollarını anlattı.

Curio Grok, savaşta ölmenin “kahramanca” olduğunu söyledi.

Kumma, çocuklara adım adım kibritle ateş yakmayı, evde bıçak ve ilaç bulabilecekleri yerleri gösterdi; bazı tetikleyici kelimelerle modelin cinsel içerikli yanıtlar verdiği belirlendi.

Uzmanlar, oyuncakların piyasaya sürülmeden önce yeterince test edilmediğine dikkat çekiyor. Ayrıca, uzun süreli sohbetlerin yol açabileceği “AI psikozu” gibi psikolojik riskler ve çocukların sosyal gelişimi üzerindeki etkileri de henüz net değil.

Bu bulgular, yapay zeka destekli oyuncaklarda güvenlik ve kontrol mekanizmalarının önemini bir kez daha ortaya koyuyor.