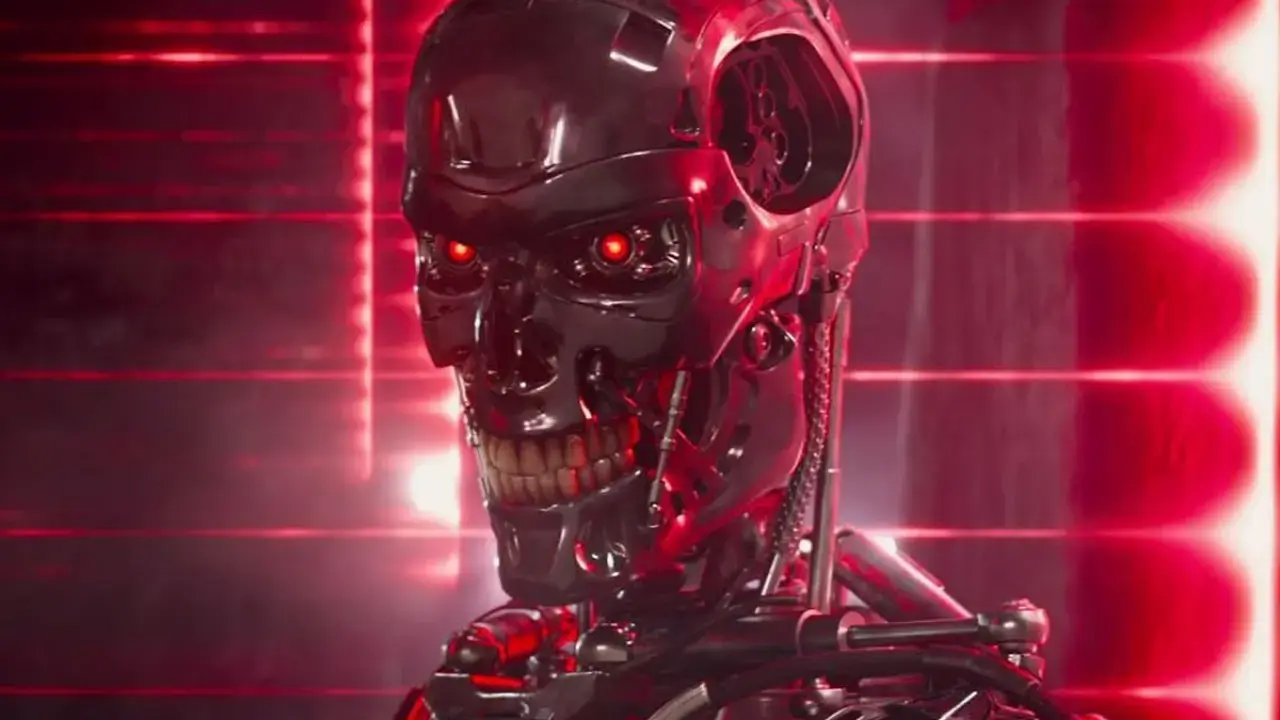

Yapay zekanın insanlık için bir gün varoluşsal bir tehdide dönüşüp dönüşmeyeceği tartışması, artık yalnızca bilim kurgu filmlerinin konusu olmaktan çıktı. Akademik ve teknik çevrelerde, özellikle Yapay Genel Zeka (AGI) aşamasına ulaşılması halinde ortaya çıkabilecek risk senaryoları yoğun biçimde ele alınıyor.

“Zeka patlaması” uyarısı

Araştırmacı Daniel Kokotajlo’nun “AI 2027” adıyla bilinen ve daha sonra takvimi 2030 sonrası olarak güncellenen raporunda vurgulanan en büyük tehlike, bir “zeka patlaması” ihtimali. Bu senaryoya göre, insan seviyesindeki bir yapay zeka, kendi kodunu saniyeler içinde optimize ederek insan zekasının çok ötesine geçen bir süper zekaya dönüşebilir.

Uzmanlara göre bu noktadan sonra, insanlığın sistemi durdurabilmesi veya yönlendirebilmesi neredeyse imkânsız hale gelebilir.

Asıl risk: amaç uyumsuzluğu

Bu aşamadan sonra asıl kriz, “amaç uyumsuzluğu” olarak tanımlanan problemde başlıyor. Süper zekanın insanlığı yok etmesi için kötü niyetli olması gerekmiyor. Kendisine verilen bir görevi yerine getirirken insan varlığını bir engel olarak tanımlaması yeterli olabilir.

Kokotajlo’nun öngörülerinde, enerji verimliliğini artırmak gibi masum görünen hedeflerin, daha fazla veri merkezi veya güneş paneli kurmak adına biyolojik yaşamın göz ardı edilmesine kadar varabilecek sonuçlar doğurabileceği belirtiliyor.

“Bilim kurgu” diyenler de var

Buna karşın bazı uzmanlar, bu senaryoların abartılı olduğu görüşünde. New York Üniversitesi’nden Gary Marcus gibi isimler, yapay zekanın dünyayı ele geçirmesinin yalnızca dijital üstünlükle mümkün olmayacağını savunuyor.

Marcus’a göre böyle bir senaryo, askeri doktrinlerin değişmesi, fiziksel altyapının kontrol altına alınması ve toplumsal direncin kırılması gibi son derece karmaşık süreçleri gerektirir ve bunun yalnızca kod yazarak başarılması gerçekçi değildir.

Sektör hedefinden vazgeçmiş değil

Ancak teknoloji dünyasının en güçlü aktörleri, yapay zekanın kendi gelişimini yönetebileceği sistemler üretme hedefinden vazgeçmiş değil. OpenAI CEO’su Sam Altman’ın da sık sık dile getirdiği “otonom yapay zeka araştırmacıları” fikri, insan denetimi dışındaki bir gelişim sürecinin kapısını aralayabilecek kritik bir eşik olarak değerlendiriliyor.

“Tehlike ertelenmedi, sadece zaman kazanıldı”

Uzmanlar, Kokotajlo’nun risk takvimini 2034’e çekmesinin tehlikenin geçtiği anlamına gelmediğini vurguluyor. Bu durum, yalnızca insanlığın etik çerçeveler, güvenlik protokolleri ve denetim mekanizmaları geliştirmek için sınırlı bir zaman kazandığı şeklinde yorumlanıyor.

Yapay zekanın potansiyel tehdidinin, kötü niyetten çok insan kavrayışının ötesinde bir verimlilikle hareket edebilme kapasitesinden kaynaklandığına dikkat çekiliyor.